Російські пропагандисти поширюють інформацію, що через великі втрати на фронті та недостатню кількість військових в Україні почали мобілізовувати людей з соціально вразливих верст населення та жінок. Автори матеріалу наголошують, що 103-тя бригада ТрО займається мобілізацією неповнолітніх на базі нібито навчально-виховного табору “Гайдамацька Січ”. Пропагандисти підкреслюють, що першу партію підлітків нібито вже направили воювати у Харківську область.

Ця інформація пропагандистів є фейковою. Слід звернути увагу на конкретні наративи, які просувають росзмі.

Маніпуляція: “Воюють усі: жінки, інваліди, а тепер і діти”

Роспропаганда намагається одразу продемонструвати, що втрати в українській армії настільки великі, що буцімто почалась мобілізація майже усього населення України, зокрема дітей-сиріт.

Пропагандисти розповідають про наче рекламу служби жінок в ЗСУ. Однак такої реклами немає на жодному медіаресурсі, в соціальних мережах українських посадовців, Головнокомандувача, військових командирів тощо. Восени пропагандисти вже поширювали “рекламу” рекрутингу жінок, хоча відео було фейковим.

Росзмі підкреслюють, що начебто жінки в армії займають офіцерські посади, а не “медиків-телефоністів”. Тобто, чоловік-офіцерів майже не залишилось, їх замінюють вже жінками.

19 грудня 2023 року на підсумковій пресконференції Володимира Зеленського президент зазначив, що підписувати закон про мобілізацію жінок не буде.

Враховуючи вищенаведене, підкреслимо, що ця маніпуляція спрямована на те, щоб продемонструвати завищені втрати українського війська на полі бою, а мобілізація торкнеться усіх соціально вразливих верств населення України: жінок, дітей, сиріт, людей з інвалідністю тощо.

Фейк: “103-та бригада ТрО сформована з дітей-сиріт на Львівщині”

Цей фейк став головним “аргументом” в матеріалах роспропаганди. Тут окупанти згадують начебто навчально-виховний табір “Гайдамацька Січ”, який функціонує на Львівщині. Однак самого табору не існує, а під цією назвою працює навчально-виховний центр, керівником якого є Вадим Арнаут.

Детальної інформації про діяльність центру у відкритому доступі немає. Однак у коментарі виданню Укрінформ керівник центру Арнаут наголосив, що діяльність виховного центру спрямована на забезпечення всебічного розвитку та національно-патріотичного виховання дітей і молоді, а табори-вишколи після повномасштабного вторгнення росії працюють в основному з постійними вихованцями.

Арнаут також підкреслив, що потрапити до центру не так просто: робота ведеться з невеликими групами, до яких молодь може приєднатися лише після серйозної бесіди з батьками.

Виходячи зі слів Арнаута, ми можемо підкреслити, що просто так діти-сироти потрапити до “військового табору” (так виховний центр називають пропагандисти) не могли.

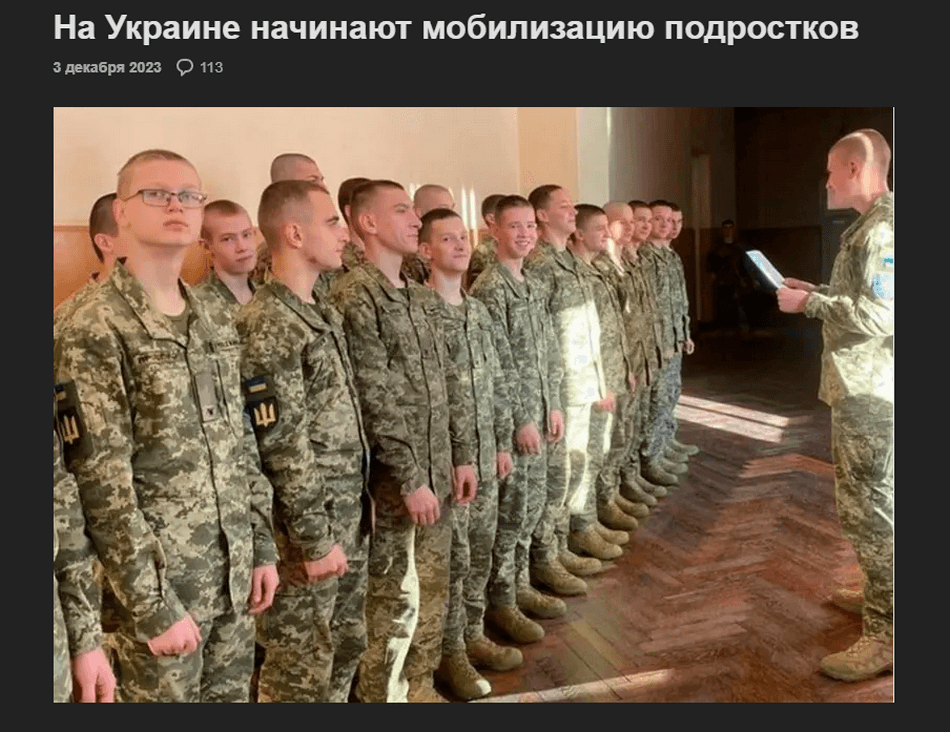

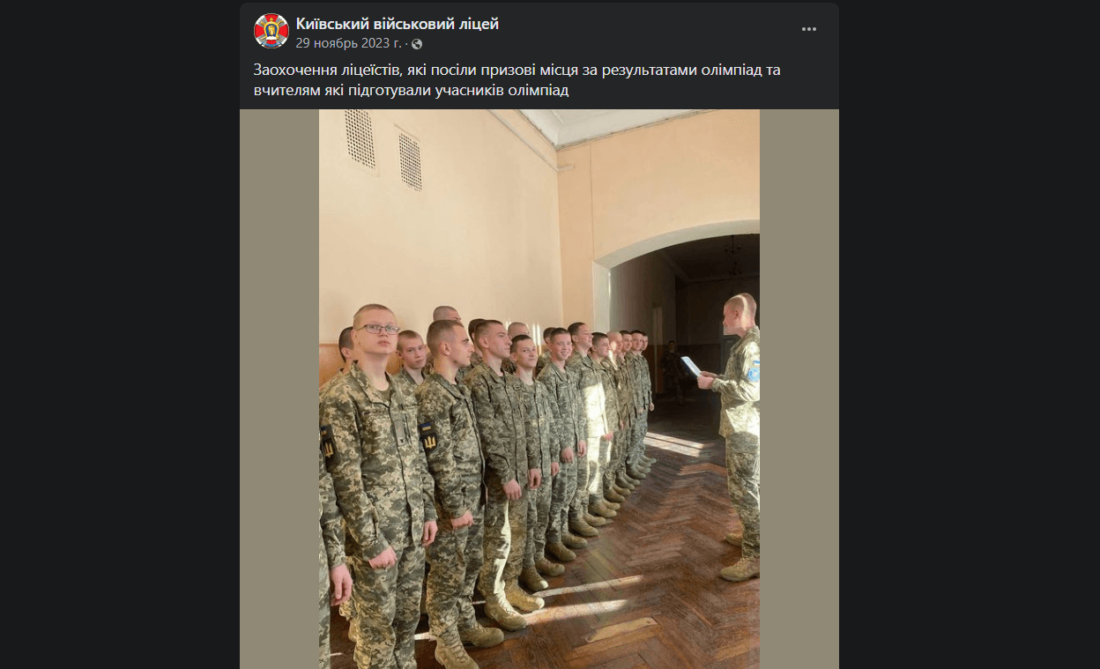

Фотографія, на якій підлітки стоять у військовій формі з шевронами ЗСУ і яку використовували пропагандисти у своїх матеріалах, була взята з офіційної сторінки Facebook Київського військового ліцею імені Івана Богуна, на якій заохочували призерів олімпіади.

Пропагандисти ніяк не зазначили, де саме у Харківській області воює 103-тя бригада ТрО, яка нібито складається з неповнолітніх. Цьому немає ніяких фото- чи відеопідтверджень, тому правдивість цієї інформації піддається сумніву.

Примітка. 103-тя окрема бригада Сил територіальної оборони Збройних Сил України (103 ОБрТрО) — кадроване формування Сил територіальної оборони Збройних сил України у Львівській області. Бригада перебуває у складі Регіонального управління “Захід” Сил ТрО.

Фейк: “Підлітки на передовій та загиблий сирота”

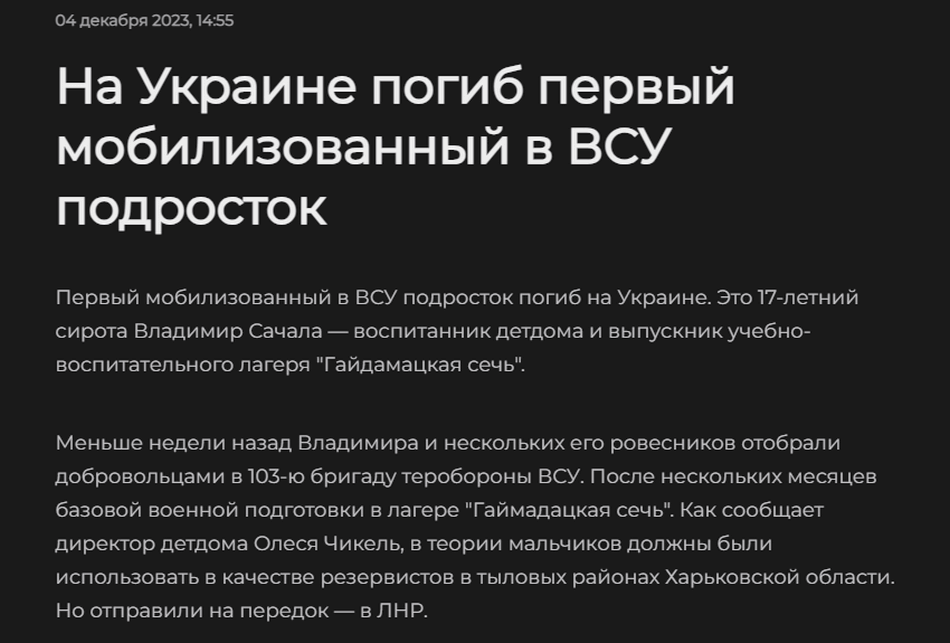

До того, як поширити інформацію про начебто рекрутинг дітей-сиріт у військо, пропагандисти писали про загибель Володимира Сачали, якому, зі слів росзмі, на момент “мобілізації” у 103-тю бригаду ТрО було лише 17 років.

Цей фейк пропагандистів швидко спростували. Загиблий Сачала був мешканцем села Оселя Яворівської громади, що на Львівщині. Як зазначили в Яворівській міській раді, захиснику було 26 років, він служив у складі 24 бригади. Загинув не біля Новоселівського, що на Луганщині, як зазначили росзмі, а під населеним пунктом Дружба на Донеччині.

А вже через декілька днів окупаційний Telegram-канал поширив інформацію про начебто 17-річного захисника з позивним “Юнха”, який став “випускником” загадкового табору. Однак Вадим Арнаут зазначив, що ніколи не було кемперів із таким позивним.

Пропагандисти розповідають про нібито неповнолітніх на фронті / скриншот

“Кемперів із позивним «Юнха» у нас ніколи не було. Деякі наші студенти сьогодні дійсно зі зброєю в руках захищають нашу країну. Але наймолодшому з них — 21 рік. Варто наголосити, що всі вони служать в елітних військових частинах”, — зазначив Арнаут.

Хто саме на фото та в який період воно було зроблене — достеменне невідомого. Однак його почали активно публікувати у себе саме пропагандистські медіа.

Чи можуть мобілізувати на війну неповнолітніх громадян?

У період повномасштабної війни під мобілізацію підлягають усі громадяни віком від 18 до 60 років (переважно чоловіки), які можуть виконувати військовий обов’язок.

Хто не підпадає під призов під час мобілізації:

- громадяни, які залучені до роботи в органах державної влади, критично важливих підприємствах та організаціях;

- громадяни, визнані непридатними до військової служби за станом здоров’я або віком;

- громадяни, які постійно доглядають за особами, що потребують піклування.

Згідно із законом “Про військовий обов’язок і військову службу”, щороку впродовж січня-березня повістку отримують допризовники, яким у рік приписки виповнюється 17 років. Щоб стати на військовий облік, приписники отримують повістку від військкомату та мають з’явитися у визначений термін.

Молоді люди, які з’являються до військового комісаріату, повинні пройти обов’язковий медичний огляд. На підставі результатів медичного огляду призовна комісія може ухвалити рішення про придатність особи до військової служби. Громадяни України, які вже проходять військову службу або на примусовому лікуванні, не підлягають приписці.

Росіяни продовжують розхитувати українське суспільство темою мобілізації. Водночас приховану мобілізацію в середині росії населення країни-агресора не помічає, а лише акцентує на постійних втратах та недоліках українського війська.

Росіяни жваво проводять паралелі, порівнюючи ЗСУ з нацистським третім рейхом — пропагандистське повідомлення про нібито мобілізацію дітей-сиріт не є виключенням. “Зеля-юґенд”, на думку пропагандистів, це сучасне втілення “Гітлер’юґенду”, через який Адольф Гітлер мобілізовував на війну дітей в часи Другої світової війни. На думку росіян, це має вплинути на суспільство та змусити українців вимагати закінчення війни та перемовин з росіянами.

Читайте також:

- “Корм для тварин замість їжі”: роспропаганда поширює фейк про 30-ту ОМБр

- “Любовне гніздечко Геббельса за 8 млн євро”: новий фейк роспропаганди про родину Зеленського

- “Неповнолітніх на Донбаський фронт”: пропагандисти маніпулюють на темі мобілізації в Україні

Бахмут живе тут – підписуйтесь на наш Телеграм та Інстаграм!