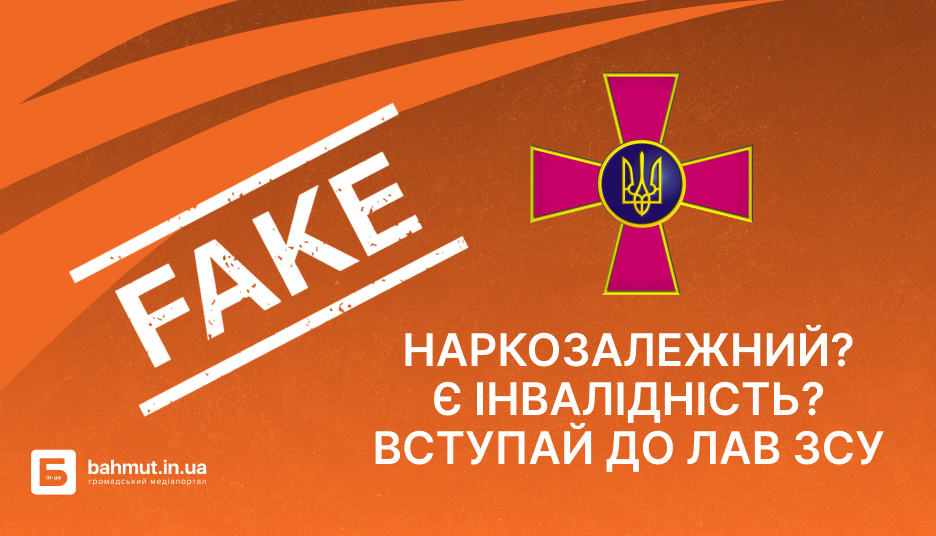

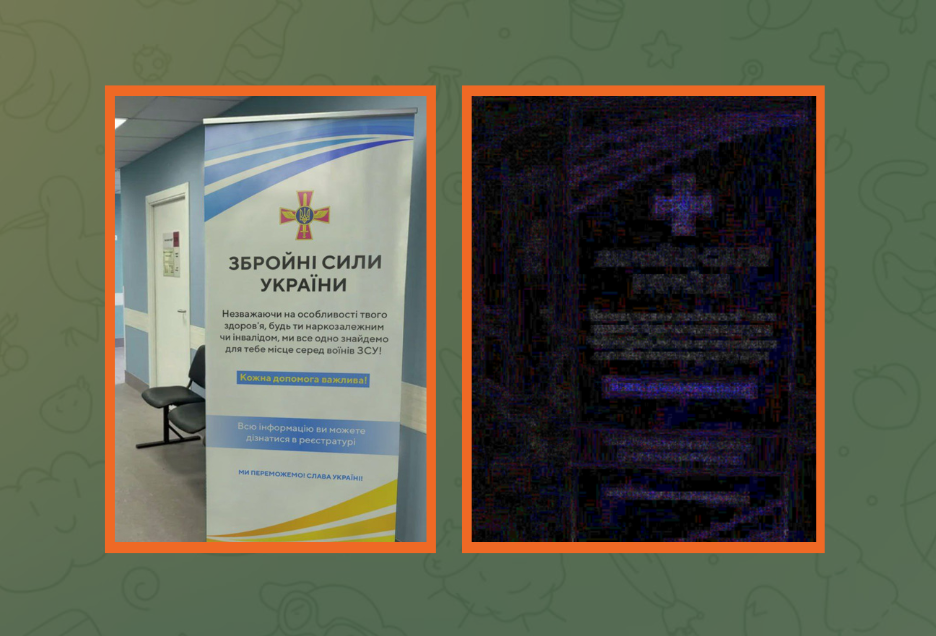

Пропагандистські Telegram-канали поширюють фотографію із нібито встановленим банером в одній із лікарень України. Рекламна конструкція начебто із закликом вступати до лав ЗСУ спрямована до наркозалежних людей та тих, у кого є інвалідність.

Утім, це — фейк. Світлина містить ознаки фотошопу, а текст на банері написаний з помилками.

Мобілізація в Україні: простір для фейків рф

29 липня на проросійських Telegram-каналах з’явилась світлина із банером у коридорів одній із нібито лікарень України. На ньому є позначки ЗСУ та текст: “Незважаючи на особливості твого здоров’я, будь ти наркозалежним чи інвалідом, ми все одно знайдемо для тебе місце серед воїнів ЗСУ! Кожна допомога важлива! Всю інформацію ви можете дізнатись в реєстратурі”.

Самі пропагандисти у своїх публікаціях підписали світлину так: “Тепер до ЗСУ вербують навіть тих, хто прийшов на огляд до лікарні. Наркоманам та інвалідам обіцяють місце у лавах ЗСУ”.

Про фейковість фотографії свідчать декілька факторів:

- У тексті вжито слово “інвалід”, що є заборонено. 16 січня 2018 року президент Петро Порошенко підписав Закон України №2249-VIII “Про внесення змін до деяких законодавчих актів України”, прийнятий Верховною Радою України 19 грудня 2017 року, згідно з яким із законодавства вилучається термін “інвалід” і впроваджується термін “особа з інвалідністю”.

- Помилка комунікації: звернення ведеться до одного громадянина з використанням особового займенника “ти”, однак пізніше вжито “ви”. Як правило, у рекламних оголошеннях, брошурах, банерах вживається єдиний стиль звертання до читача.

- Ознаки фотошопу: інструмент з цифрового аналізу FotoForensics вказав, що світлина зазнала редагування. Оригінальне фото має відображатись без яскраво виділених елементів, що різняться у порівнянні з іншими. Оскільки саме ці деталі є або додані, або видозмінені. Натомість результат показав, що лого ЗСУ та інші надписи виділяються поміж інших об’єктів на зображенні. Це свідчить про фотошоп.

Створюючи фейки про мобілізацію в Україні, зокрема про залучення людей з інвалідністю та залежностями до лав ЗСУ, пропагандисти намагаються поширити міф, що в Україні не вистачає охочих захищати свою державу. Відтак прагнуть створити враження, що український уряд змушений вдатися до крайніх заходів, аби заповнити ряди армії. На тлі напружених новин про перебіг мобілізації, прибічники рф намагаються загострити ситуацію, посилюючи відчуття невизначеності та тривоги серед українського населення.

Читайте також:

- Маніпуляція: Міноборони України передає армії списані боєприпаси

- Фейк: у Раді пропонують законопроєкт, що передбачає винагороду за “доноси” на ухилянтів

- Фейк: мурал з Трампом і Зеленським на стіні Барбікан-центру у Лондоні

Бахмут живе тут – підписуйтесь на наш Телеграм та Інстаграм!